2020年11月09日

最先端技術

研究員

新西 誠人

日本危機管理学会は2020年10月24日、企業危機管理研究部会(部会長・大森朝日理事)の2020年度第1回会合「最新の企業をめぐる危機管理情勢」を開き、3人が報告した。

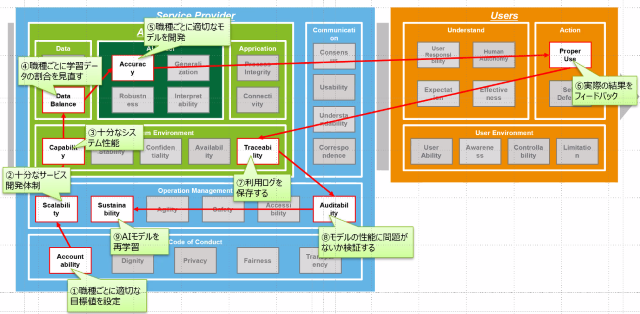

最初の報告は、松本敬史氏(東京大学未来ビジョン研究センター客員研究員/有限責任監査法人トーマツ・マネジャー)による「AIサービスのリスク低減を検討するリスクチェーンモデル」である。

人工知能(AI)の社会実装が進むにつれ、各種差別を助長したり、自動運転の車両が事故を起こしたりと、その信頼性に関わる問題も顕在化する。これまでの技術フレームワークと違うのは、AIによる判断が不公平感をもたらし、しかも制御が困難ということだ。このため「信頼できるAIサービスの実現」は喫緊の課題である。

不確実性のある技術をどう管理すべきか。国際機関・各国政府・標準化団体等がAIについてのガイドラインを策定している。しかし、ガイドラインを単純にチェックリストとして用いた場合、AIサービス固有の重要なリスクに必ずしも対応できないという課題も指摘される。

なぜならAIを完全に制御することが難しいほか、ステークホルダー(利害関係者)も複数存在するからだ。こうした状況でリスクにどう対応すべきか。松本氏が提案するのは「AIサービス固有の重要なリスクシナリオ」を識別し、様々なリスク要因の関係性(=リスクチェーン)を捉えるモデルである。リスクの要素は、各種ガイドラインを基に代表的なものを抽出したという。

採用AIのリスクチェーンの例

採用AIのリスクチェーンの例

(出所)松本敬史氏

リスクチェーンのモデルでは、AIサービスの特徴ごとに代表するリスクを見出し、リスク要因が技術か運用かユーザーなのかを抽出して結び付ける。そのチェーンに基づいてリスクを下げるというわけだ。現在、松本氏はさまざまなケーススタディを行っており、今回は「採用AI」を例に挙げてリスクチェーンモデルを説明した。

報告者・松本敬史氏

報告者・松本敬史氏

続いての報告は、飯塚康之氏(万来社代表・危機管理セミナー講師)による「コロナ後のリスクマネジメントを提案する~起こってしまった危機に、どう対処するか~」である。コロナ禍により、様々なリスクが顕在化した。イベントなどは相次いで中止や延期に追い込まれた。

飯塚氏は企業のリスクマネジメントの要諦として、(1)クレームに対して反論してはならない(2)対処内容の概要を広報する(3)危機時に安全管理は役立たない(4)軽い失敗を体験しておく(5)日常性にこそ意味がある(6)人間の行動の特性を知る(7)過去の『失敗例』に学ぶ―という7つの鉄則を紹介した。

中でも、危機管理を「いつ起こるかわからない予防的なもの」とせず、日常的な予算に組み込んでおくことが重要だという。例えば、コールセンターは外部委託するのではなく、顧客のナマの声に耳を傾けられる貴重な機会とすべく常に予算化しておく。クレームから逃げずに対応してこそ、筋肉質で利益が出るような会社にできると主張した。

報告者・飯塚康之氏

報告者・飯塚康之氏

最後の報告は、大森朝日氏(株式会社大森朝日事務所代表)による「記者会見における危機管理対応の変化~衆人環視下の問題点~」である。

5年ほど前から記者会見のネット中継が本格化し、コロナ禍がそれを加速させている。今までの「記者独占」から「一般化」する変化だ。ただし、企業の不祥事会見は依然、リアルで行われることが多いという。

記者会見がネット中継になることで、大森氏は「威嚇的質問が少なく」「一般も人も見られるように」なるなどのメリットを指摘。その一方で、「表情や動作がそのまま放送されてしまう」「詳細な発言の記録が残る」などの課題も挙げた。とはいえ、今後も記者会見はネット中継が増え、記者クラブが形骸化するのではないかと予測した。

報告者・大森朝日氏

報告者・大森朝日氏

日本危機管理学会の活動や入会に関心のある方はホームページを御参照ください(https://crmsj.org/)。

(写真)筆者

新西 誠人

※本記事・写真の無断複製・転載・引用を禁じます。

※本サイトに掲載された論文・コラムなどの記事の内容や意見は執筆者個人の見解であり、当研究所または(株)リコーの見解を示すものではありません。

※ご意見やご提案は、お問い合わせフォームからお願いいたします。